对话RealAI:从底层技术框架出发,引入贝叶斯深度学习,推动第三代AI发展

安全、可靠、可信的第三代人工智能将快速推动技术应用落地。

“我们给公司取名‘RealAI’,意在探索真正的人工智能。其实现在的AI技术距离真正的人工智能还有很长的路要走。”

那什么才是真正的AI呢?在RealAI看来,“真正的AI应该是有理解能力、具备‘人类智能水平’的AI。”

后深度学习时代的人工智能

2016年,清华大学人工智能研究院院长张钹院士首次提出了“后深度学习时代的人工智能”的概念,并就AI技术发展做了阶段性分类。简单来说,AI技术发展主要分为三个阶段:

第一代,“知识驱动型”AI,以规则模型/符号模型为主的符号主义AI,可以从宏观层面模拟人类行为,但对于无法精确描述的知识束手无策;

第二代,“数据驱动型”AI,以深度学习为代表,对领域知识要求不高,可以通过深度神经网络建立计算模型,从数据中发现规律,但高度依赖大量高质量的训练数据;

第三代,“知识驱动+数据驱动型”AI,即安全、可靠、可信的AI,白盒化AI模型提供可理解的决策依据,即便在样本不足、噪音高、标注差等未知场景中也能够可靠提升预测效果以及持续保持较高的判断力。

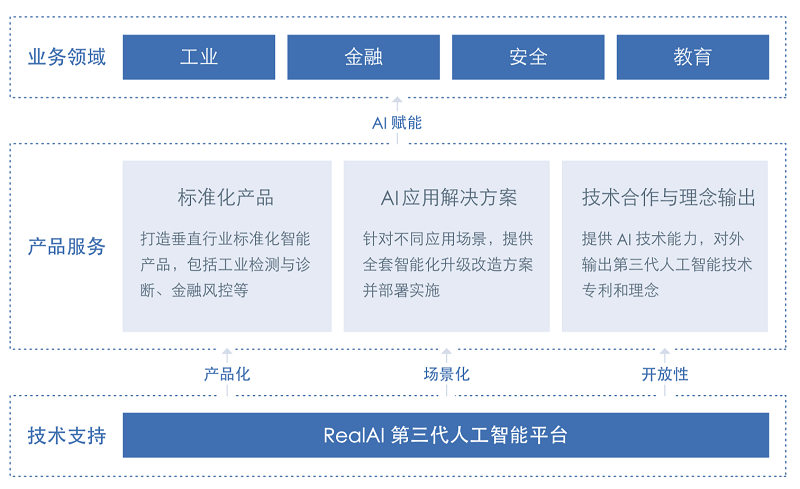

目前以深度神经网络为代表的AI技术尚处于第二阶段,鲁棒性较差、易受干扰,并且决策过程为“黑盒”,可解释性差,这也直接导致了关键AI技术在落地应用时达不到预期。基于此,清华大学率先倡导发展第三代人工智能,而RealAI作为清华大学人工智能研究院的核心孵化企业,其主要目标是从底层技术框架出发,专注第三代人工智能基础技术研究,并探索其产业落地方向,致力于让前沿AI技术在生产、生活中得到真正的应用。

值得一提的是,去年9月,美国国防高级研究计划局DARPA也相继发布了“AI NEXT”计划,该计划将斥资20亿美元,围绕“新能力、可靠性、对抗性、高性能和可解释性”五大方向,旨在推动人工智能第三次浪潮。可以说,当前中美两国针对第三代人工智能的竞争已经展开,清华大学、RealAI等中国研究机构和企业则是抢占了先机。

引入贝叶斯深度学习,用概率统计方法模拟人类决策

实际上,人工智能很多时候需要做“预测问题”,要让AI具备人脑的判断、决策能力,就需要让AI学习人类在做预测时的决策过程——即“先假设,再找论据进行修正”的方法,先对现象做预判,再基于知识或数据给予这个预判以修正。例如,人类在判断明天是否下雨的时候,会先做假定,再去观察云层、风力、气温等,并基于看到的现象去验证“下雨”的可能性,即由果寻因。

那么,如何让AI也具备这样的能力?RealAI给出的答案是,贝叶斯深度学习。从技术本身来看,贝叶斯深度学习以贝叶斯理论为核心,即利用概率表示所有形式的不确定性,通过概率规则来实现学习和推理过程,是一种从概率统计的角度定义问题的方式。简单来说,就是“把先验知识应用到决策过程中”,此处的“先验知识”也就是人类在观察到一些现象之前基于经验对最终问题答案做出推断预测。

所以,贝叶斯深度学习其实是融合了贝叶斯学习和深度学习的技术特点,将“知识”与“数据”结合起来,对结构化的先验信息建模,让AI在决策时更接近人脑的思维方式,同时更精确的总结出数据分析后的经验。

可以说,贝叶斯深度学习技术为处理不确定信息、提高可解释性提供了新方法。映射到应用效果层面,贝叶斯深度学习技术支持不确定性建模,对脏/假数据、数据缺失的容忍度显著提升,能够从概率角度刻画真实性,实现“黑盒”模型白盒化,输出模型层面与实例层面的解释依据,算法模型更鲁棒、更安全。

依托于贝叶斯深度学习,RealAI较其他AI企业在人工智能领域走的更深一步,同时也铸就了其他企业在短期内无法突破的技术壁垒。

发掘有价值的应用场景,就不会存在所谓的泡沫

正如Gartner技术成熟度曲线所展示的,一项技术刚出来的时候,公众往往会高估其应用价值。所以,在AlphaGo击败人类围棋选手、OpenAI在电子游戏“Dota”中战胜人类职业玩家等一系列典型AI事件发生后,整个行业开始出现一些不合理的预期或是过于异想天开的设想,这也导致了部分概念型AI公司的出现。2019年以来AI行业开始趋于冷静,但此前预想的“变革性”AI应用并未出现,于是,“行业泡沫”、“AI寒冬”等言论一时间纷纷四起。

“其实AI技术本身是不存在泡沫的,只要找到真正有价值的场景并与之结合,AI行业也不会存在所谓的泡沫。”在RealAI看来,确保安全是AI可信应用的基础,因此RealAI将AI技术的安全性作为重点研究方向之一,通过预防AI潜在风险,推动产业健康发展。

随着AI技术在各大领域中的广泛应用,越来越多潜在的安全风险也暴露出来,如果不对AI安全问题加以重视,甚至将可能引发如催生出色情产业链的Deepfake这样的恶性事件。

其实早在2015年,RealAI的创始团队就意识到“安全问题”将会是未来AI发展过程中不可避免的一环,而Deepfake事件也印证了一旦缺乏防御技术的抵御、监管机制的遏制,AI技术的使用最终会走向不可控,这也更加坚定了RealAI的想法:AI安全需求在未来一段时间内将迎来爆发式增长。

为此,今年5月,RealAI正式推出了与清华大学联合开发的RealSafe人工智能安全平台,支持对多种AI算法进行漏洞检测与漏洞修复,并输出AI算法的安全性评测报告。与国际知名科技企业旗下的AI安全平台相较,RealSafe支持更为通用的模型、更丰富的对抗攻击和防御算法,具有领先优势。

此外,RealAI还将业务拓展至工业和金融两大对AI鲁棒性、解释性要求较高的领域。工业方面,RealAI自主研发智能制造决策系统。在制造环节,通过智能检测技术提升质检稳定性、降低成本;在运行环节,通过对设备检测信号的分析,利用算法找出潜在异常,从而实现对设备健康状况的评估和预测,提高使用寿命,找到引发故障的原因。目前,该领域的相关技术成功应用于光伏EL智能缺陷检测、大坝安全智能评估、石油管道缺陷检测等实际场景中。

金融方面,依托贝叶斯深度学习在无标签、少标签、冷启动和不确定性处理等场景有更好的模型表现,以及拥有黑盒转白盒的可解释性优势,RealAI自主研发了一键端到端建模平台,支持智慧建模和模型部署,流水类数据导入即可建模,帮助金融机构解决传统建模流程慢、模型评估困难、迭代成本高等问题。

在风险评估方面,RealAI还推出了独有的零售信贷风控回捞方案,通过采用生成式模型等技术,支持对全体贷款申请群体进行建模,解决了深度学习技术对于标签数据高依赖的难题,风险识别也更加精准,可以做到从被拒绝贷款的“坏”客户中“回捞”一部分用户,并且保证回捞用户放款后的整体风险水平与原本通过审核的用户拥有相同的不良率。

归根结底,AI是一项非常有用的技术,只要找到合适的场景就能够发挥出作用。作为一支对未来AI充满热爱的团队,RealAI仍然相信,无论是AI技术本身还是AI产业都还是处于快速发展的阶段。

最后,记得关注微信公众号:镁客网(im2maker),更多干货在等你!

硬科技产业媒体

关注技术驱动创新

Go

张钹

性能

智能

金融

Go

张钹

性能

智能

金融

微信ID:im2maker

微信ID:im2maker

长按识别二维码关注

长按识别二维码关注